Copilot for Security vuole rispondere alle principali sfide di sicurezza che oggi le organizzazioni devono affrontare includono:

- Un aumento del numero e della sofisticazione degli attacchi.

- Una disponibilità di risorse umane in ambito sicurezza non adeguata che sta determinando la necessità di automazione, integrazione e consolidamento degli strumenti di protezione.

- Necessità di avere una visibilità a 360 gradi su sicurezza, privacy, conformità e governance.

Le organizzazioni devono agire rapidamente per affrontare tutte le sfide alla sicurezza che devono affrontare, ma lavorare alla velocità umana non è sufficiente. Le organizzazioni devono lavorare alla “velocità della macchina”.

Microsoft Copilot for Security è uno strumento di analisi della sicurezza nel cloud basato sulle soluzioni di intelligenza artificiale generativa di Microsoft che consente agli analisti di rispondere rapidamente alle minacce, elaborare i segnali alla velocità della macchina e valutare l’esposizione al rischio più rapidamente di quanto sarebbe altrimenti possibile.

Tra i vantaggi dell’utilizzo di una soluzione come questa abbiamo:

- La possibilità di utilizzare un linguaggio naturale nella fase di prompting effettuata dall’ operatore di sicurezza

- La velocità di correlazione di diverse fonti inerenti la specifica richiesta al fine di generare una risposta utile ad indirizzare una problematica di sicurezza.

- Può essere utilizzata come soluzione stand-alone o, grazie ai principi di integrazione con cui è stata disegnata, all’ interno delle principali soluzioni di sicurezza e management Microsoft come Microsoft Defender XDR, Microsoft Sentinel, Microsoft Intune ma anche all’interno di servizi terze parti come ServiceNow.

- Estendibilità della soluzione grazie ad un’architettura basata su plugin. Di fatto un plugin può essere visto come un connettore verso uno specifico servizio che vogliamo utilizzare come sorgente dati per le attività di analisi in ambito sicurezza. Alcuni plugin sono preinstallati di default (Plugins overview Microsoft Copilot for Security (Preview) | Microsoft Learn), altri sono disponibili e possono essere aggiunti a seconda delle necessità (Other plugins for Microsoft Copilot for Security | Microsoft Learn) e altri ancora possono essere sviluppati appositamente (Create your own custom plugins in Microsoft Copilot for Security | Microsoft Learn).

Casi d’uso per Copilot for Security

Vediamo di seguito quali potrebbero essere i principali casi d’uso per questa soluzione

Riepilogo degli incidenti di sicurezza

Tramite l’IA generativa è possibile ottenere rapidamente un riepilogo di incidenti anche complessi in modo da avere in modo rapido un’indicazione del contesto e dei passi decisionali necessari per effettuare un’opportuna remediation.

Analisi degli impatti

Grazie a metodologie analitiche basate sull’ utilizzo dell’IA è possibile valutare il potenziale impatto degli incidenti di sicurezza permettendo approfondimenti sui sistemi e dati interessati e di prioritizzare le adeguate risposte in modo efficace.

Reverse engineering di script malevoli

Viene eliminata la necessità di effettuare manualmente l’analisi e il reverse engineering dei malware permettendo a qualunque analista di comprendere le azioni eseguite da un attaccante. Copilot for security permette l’analisi di complesse linee di comando contenute negli script che vengono altresì tradotte in un linguaggio naturale con chiare spiegazioni delle azioni correlate.

Risposta guidata

Grazie all’analisi effettuata tramite Copilot for security è possibile ricevere indicazioni passo passo per rispondere all’incidente incluse indicazioni per la valutazione, investigazione, contenimento e remediation.

Come funziona Copilot for security ?

È possible accedere alle funzionalità di Microsoft Copilot for Security sia attraverso un’esperienza di tipo standalone sia attraverso modalità embedded integrate in altri prodotti di sicurezza Microsoft.

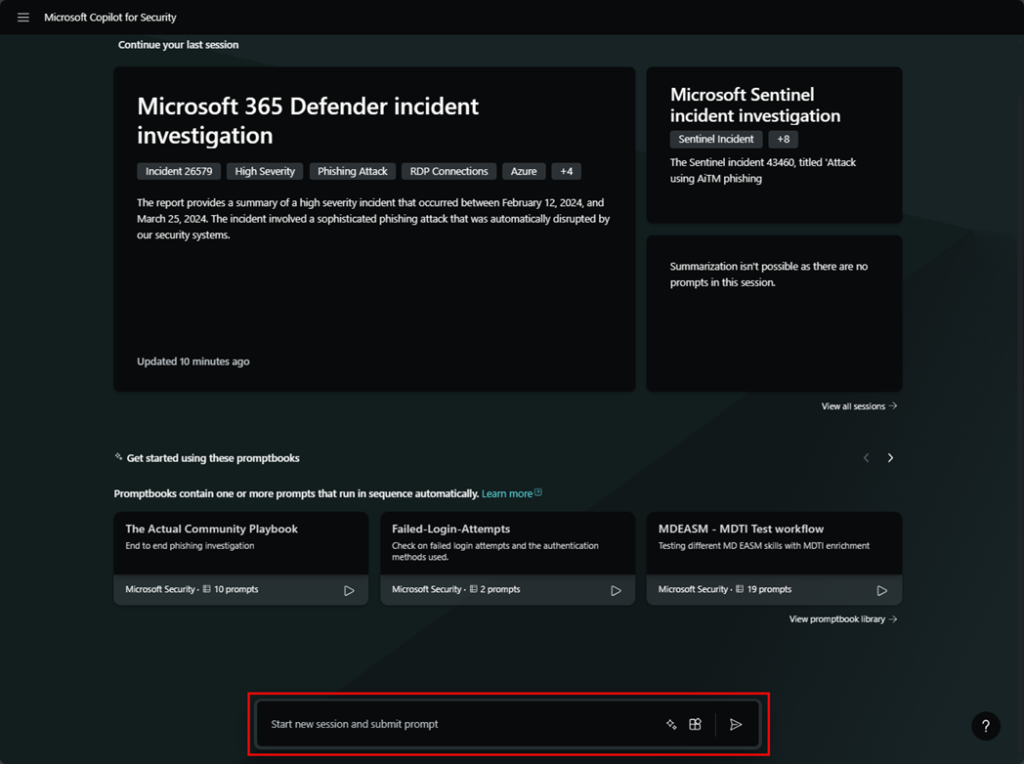

Esperienza Standalone

È possibile utilizzare Copilot for security attraverso il sito dedicato in quella che viene definita anche come esperienza standalone. Gli utenti interagiscono con Copilot tramite la barra dei prompt. Nella barra dei messaggi di richiesta gli utenti effettuano richieste in linguaggio naturale e ricevono output di risposta come testo, immagini o documenti.

Al centro di Microsoft Copilot for Security c’è la barra dei prompt. Si utilizza la barra dei prompt per indicare a Copilot quali informazioni si desidera ottenere dai dati di sicurezza, questo viene definito prompt. In altre parole, il prompt è l’input in linguaggio naturale basato su testo fornito nell’apposita barra attraverso il quale viene chiesto a Copilot di generare una risposta.

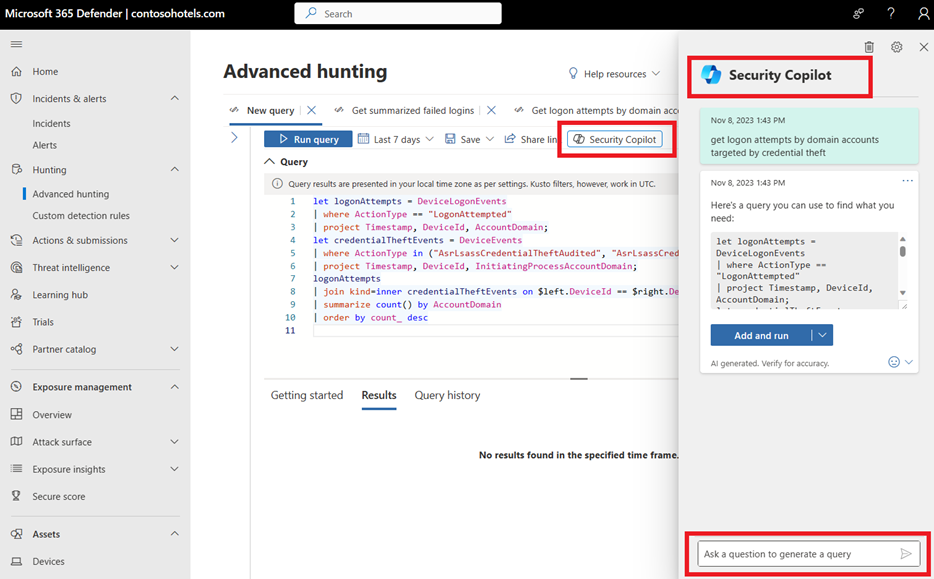

Esperienza “embedded” o incorporata

Alcuni prodotti di sicurezza Microsoft incorporano le funzionalità di Copilot direttamente nell’interfaccia utente dei prodotti. Questa esperienza viene definita esperienza “embedded” o incorporata. Microsoft Defender XDR, ad esempio, abilita le funzionalità di Copilot, tra cui il riepilogo degli eventi imprevisti, l’analisi degli script, la generazione di query basate su Kusto Quesry Language (KQL) e altro ancora.

Abbiamo detto che Copilot si integra con varie fonti tramite plug-in, inclusi i prodotti di sicurezza di Microsoft come Microsoft Sentinel, Microsoft Defender XDR e Microsoft Intune, soluzioni non Microsoft e feed di intelligence open source. L’integrazione abilitata dal plug-in, per qualsiasi origine dati specifica, fornisce a Copilot una raccolta di funzionalità. Ogni funzionalità è come una funzione nel software, è progettata per svolgere un’attività specializzata nell’ambito dell’origine dati. Ad esempio, il plug-in per Microsoft Defender XDR include una raccolta di singole funzionalità usate solo da Microsoft Defender XDR.

Natural language processing (NLP) e LLM

Copilot utilizza i servizi di Azure OpenAI ed è progettato per integrarsi con gli strumenti e i processi di sicurezza esistenti, rendendo più facile per le organizzazioni migliorare la propria posture di sicurezza complessiva. Azure OpenAI fornisce l’accesso ai suoi Large Language Models (LLM) per l’elaborazione del linguaggio naturale (NLP), fornendo al contempo le funzionalità di sicurezza di Microsoft Azure.

Copilot combina le potenzialità fornite dai LLMs con le specifiche fonti di sicurezza Microsoft. Queste fonti di sicurezza sono alimentate dai servizi di intelligence globale sulle minacce di Microsoft, oltre 65 trilioni di segnali giornalieri e incorporano informazioni di soluzioni di sicurezza che utilizzano plug-in e connessioni alle knowledge base. Tramite i plug-in, Copilot si integra con i prodotti di sicurezza Microsoft, i prodotti non Microsoft e i feed di intelligence open source. Le connessioni alle basi di conoscenza di un’organizzazione offrono a Copilot un contesto più ampio, con risposte più pertinenti, specifiche e personalizzate per l’utente. Attraverso la potente combinazione di modelli generali avanzati e fonti specifiche per la sicurezza, Copilot è in grado di apprendere a “velocità macchina” per aiutare gli analisti a identificare e rispondere alle minacce emergenti.

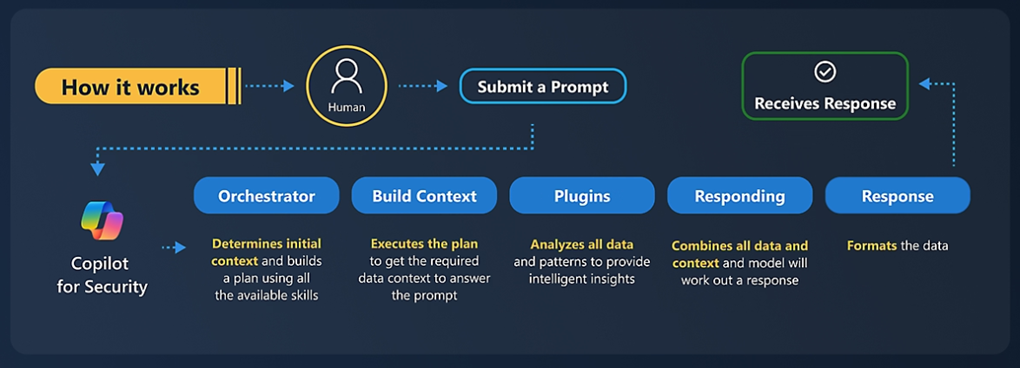

Flusso

Quando un utente invia un prompt, Copilot lo elabora per generare la migliore risposta possibile. Il diagramma seguente illustra, a livello generale, i passaggi che Copilot esegue per elaborare la richiesta e generare una risposta.

- Invio di un prompt: il processo inizia quando un utente invia un prompt nella relativa barra.

- Orchestrator: Copilot for Security invia le informazioni al back-end Copilot denominato orchestrator. L’agente di orchestrazione è il sistema di Copilot per la composizione di funzionalità per rispondere alla richiesta di un utente. Determina il contesto iniziale e costruisce un piano utilizzando tutte le capacità e strumenti disponibili.

- Contesto di compilazione: una volta definito e creato un piano, Copilot lo esegue per ottenere il contesto dati richiesto per rispondere al prompt.

- Plugin: nel corso dell’esecuzione del piano, Copilot analizza tutti i dati e i modelli per fornire informazioni intelligenti. Ciò include la valutazione di tutti i plug-in e le fonti di dati, abilitati e disponibili per Copilot.

- Composizione della risposta: Copilot combina tutti i dati e il contesto e utilizza le potenzialità del suo LLM avanzato per comporre una risposta utilizzando un linguaggio che abbia senso per un essere umano.

- Revisione della risposta: prima che la risposta possa essere inviata all’utente, Copilot formatta e rivede la risposta come parte dell’impegno di Microsoft per un’intelligenza artificiale responsabile.

- Ricezione della risposta: il processo culmina con l’utente che riceve la risposta da Copilot.

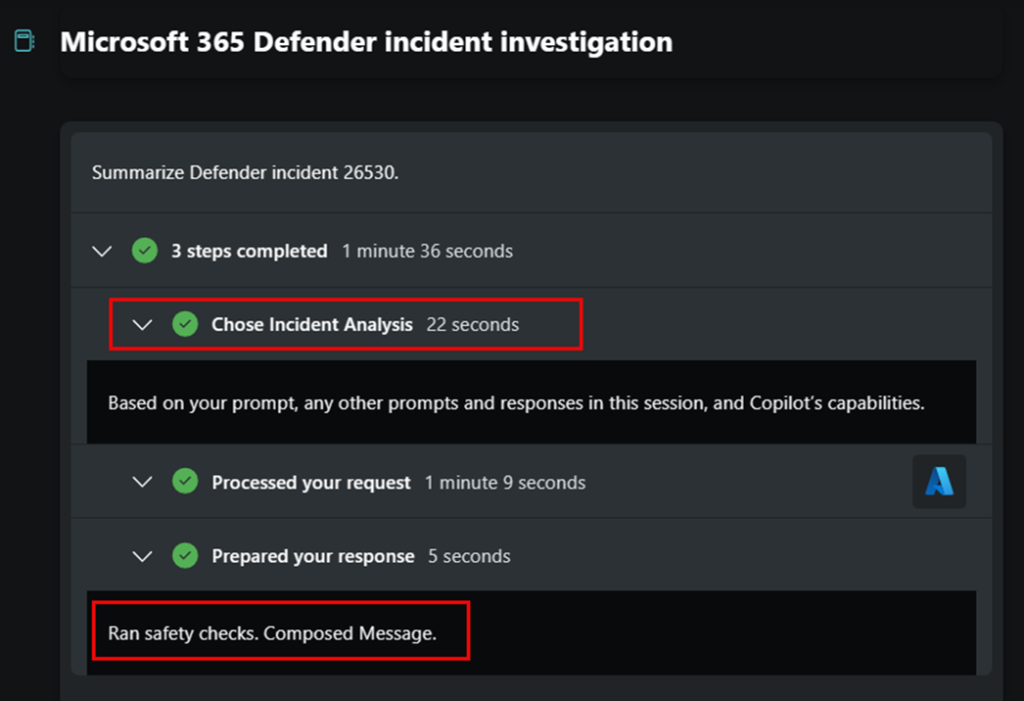

Durante questo processo, Copilot genera un registro di processo visibile all’utente. L’utente può vedere quale funzionalità viene utilizzata per generare la risposta. Questo è importante perché consente all’utente di determinare se la risposta è stata generata da un’origine attendibile. Nella schermata seguente, il registro del processo mostra che Copilot ha scelto la funzionalità di analisi degli incidenti. Il registro dei processi mostra anche che l’output finale è stato sottoposto a controlli di sicurezza, che fa parte dell’impegno di Microsoft per un’intelligenza artificiale responsabile.

Cenni su come abilitare Copilot for security

Per iniziare a usare Microsoft Copilot for Security, è necessario eseguire l’onboarding del servizio e degli utenti.

Questi includono:

- Effettuare l’ allocazione della capacità. Microsoft Copilot for Security viene venduto come offerta a consumo mensile fatturata a seconda della capacità di cui è stato effettuato il provisioning su base oraria. La capacità di cui viene effettuato il provisioning viene definita Security Compute Unit (SCU). Una SCU è l’unità di misura della potenza di calcolo utilizzata per eseguire Copilot sia nell’esperienza standalone che in quella integrata. Prima che gli utenti possano iniziare a utilizzare Copilot, gli amministratori devono allocare la capacità, il che richiede:

- Una sottoscrizione Azure.

- Avere i diritti di Azure owner o Azure contributor almeno a livello del Resource Group in cui vengono allocate le SCU

- Configurare l’ambiente predefinito. Per configurare l’ambiente predefinito, è necessario disporre di uno dei seguenti ruoli ID Microsoft Entra:

- Global administrator

- Security administrator

- Assegnare le autorizzazioni e i ruoli. Per garantire che gli utenti possano accedere alle funzionalità di Copilot, devono disporre delle autorizzazioni di ruolo appropriate. Le autorizzazioni possono essere assegnate usando i ruoli ID di Microsoft Entra o Copilot per i ruoli di sicurezza. Come procedura consigliata, specificare il ruolo con privilegi minimi applicabile per ogni utente. I ruoli ID di Microsoft Entra sono:

- Global administrator

- Security administrator

- Security operator

- Security reader

I dettagli dei tre step precedenti vanno al di là dell’ obiettivo di questo post e sono recuperabili nella documentazione relativa ai requisiti minimi per il servizio.

Conclusione

In questo post abbiamo voluto fornire una prima introduzione a Copilot for security ed alcune indicazioni del perché questo tipo di soluzioni basate sui servizi e LLM di Intelligenza Artificiale stanno diventando sempre più importanti ed utili per chi opera nel campo della sicurezza informatica. Nei prossimi post forniremo alcuni approfondimenti su aspetti specifici di questa soluzione perciò … alla prossima!